Agentic AI

AI-Systeme, die im Alltag funktionieren — nicht nur in der Präsentation.

Die meisten AI-Projekte scheitern nicht an der Technologie — sondern daran, dass AI-Systeme wie ein Experiment behandelt werden statt wie ein Ingenieursprojekt. Wir bauen Systeme, die in Produktion bestehen.

Warum AI-Projekte scheitern

Über 40% aller AI-Projekte werden eingestellt — wegen steigender Kosten, unklarem Nutzen oder fehlender Planung für den Betrieb. Nur 11% der Unternehmen haben AI-Systeme tatsächlich produktiv im Einsatz. Das ist kein Technologieproblem. Es ist ein Architektur- und Planungsproblem.

Unnötige Komplexität

Die meisten AI-Systeme scheitern nicht an fehlender Intelligenz — sondern an unnötiger Komplexität. Das führt zu Instabilität und sie sind dazu noch teuer und schwer wartbar. Einfachheit ist kein Kompromiss — sie ist Voraussetzung für Stabilität.

Fehlende Grundlagen

AI-Systeme arbeiten nur so gut wie die Daten und der Kontext, den sie erhalten. Ohne solide Daten Grundlagen und durchdachtes Context Engineering bleiben selbst die besten Modelle unzuverlässig.

Kein Plan für den Betrieb

Prototypen in der Sandbox funktionieren immer. In Produktion kommen Sicherheit, Compliance, Fehlerbehandlung und laufende Wartung hinzu. Wer AI-Systeme ohne diese Planung baut, baut auf Sand.

Entscheidende Erkenntnis: Aktuelle Forschung (2026) zeigt, dass über 90% aller Fehler in AI-Systemen klassische Software-Engineering-Probleme sind — Kompatibilitätsprobleme, fehlende Validierung, Fehlerbehandlung. Wer AI-Systeme mit Ingenieursdisziplin baut, löst den Großteil der Probleme, bevor sie entstehen.

Worauf es in Produktion ankommt

Drei Dimensionen entscheiden, ob ein AI-System im Betrieb zuverlässig funktioniert — oder beim nächsten Sonderfall zusammenbricht.

Klare Aufgabenverteilung

AI-Systeme funktionieren, wenn jeder Agent eine klare Rolle hat. Die richtige Architektur entscheidet, ob ein System skaliert oder im Kreis läuft. Unser Prinzip: die einfachste Lösung, die die Aufgabe löst — Komplexität nur dort, wo sie nachweisbar Mehrwert schafft.

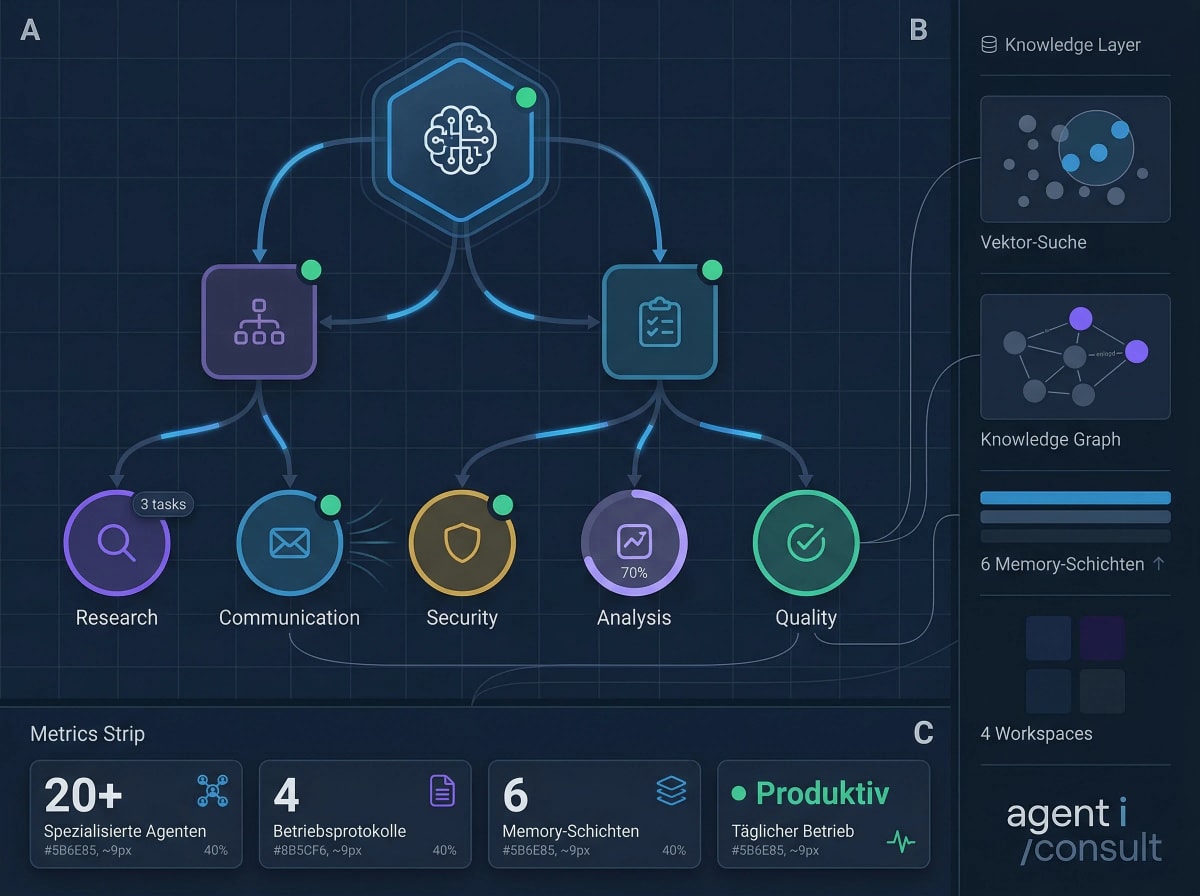

Kontext & Wissen

AI-Systeme scheitern an fehlendem Kontext, nicht an fehlender Intelligenz. Strukturiertes Wissensmanagement, persistente Erinnerung und gezieltes Retrieval sind die Basis für zuverlässige Ergebnisse — unabhängig vom eingesetzten Modell.

Qualitätssicherung & Kontrolle

Ohne systematische Tests und Überwachung ist jedes AI-System eine Blackbox. Testszenarien, automatisierte Prüfungen und menschliche Kontrollpunkte trennen Demo von Produktion. Dazu gehört auch EU AI Act-konforme Dokumentation und Nachverfolgbarkeit.

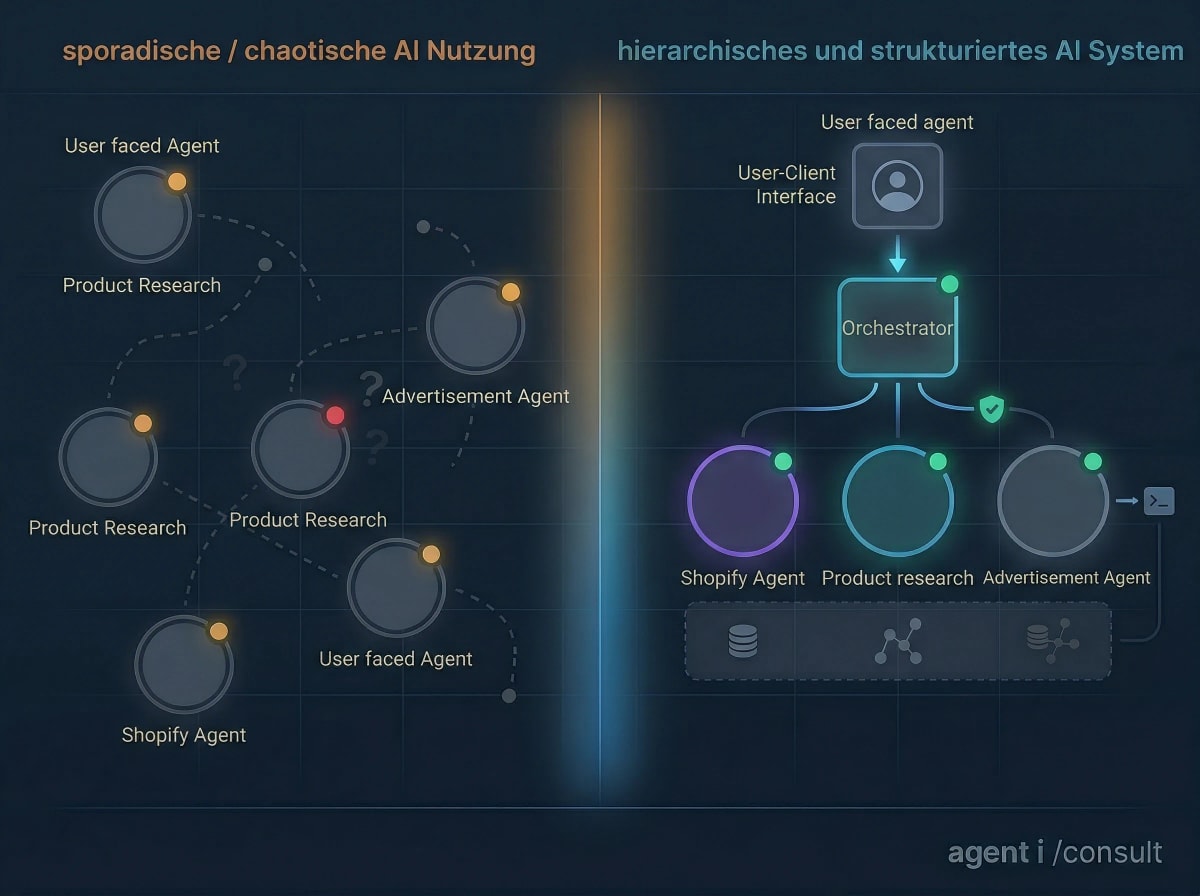

So strukturieren wir AI-Systeme

In der Praxis entscheidet die Architektur über Erfolg oder Scheitern — nicht das Modell. Wir setzen auf bewährte Muster, die wir selbst in Produktion betreiben: vom einfachen Pipeline-Ablauf bis zur spezialisierten Orchestrator-Worker-Hierarchie.

Unser Grundsatz: Das einfachste System, das die Aufgabe löst. Multi-Agent-Systeme können Kosten exponentiell treiben — jeder zusätzliche Agent vervielfacht Token-Verbrauch, Komplexität und Fehlerquellen. Durch optimiertes Context Engineering und gezielte Spezialisierung halten wir Systeme schlank, stabil und bezahlbar. Komplexität nur dort, wo sie nachweisbar Mehrwert schafft.

Ein Orchestrator-Worker-System mit spezialisierten Agenten übertrifft einen einzelnen, generalistischen Agenten um über 90% — bei gleicher Aufgabe, durch parallele Spezialisierung und klare Aufgabentrennung.

Sequential / Pipeline

Agenten in definierter Reihenfolge — jeder verarbeitet das Ergebnis des vorherigen. Für klar strukturierte Abläufe, bei denen ein Schritt auf dem vorherigen aufbaut.

Concurrent / Fan-out

Mehrere Agenten bearbeiten dieselbe Eingabe parallel. Ergebnisse werden zusammengeführt. Für Aufgaben, die sich in unabhängige Teilschritte zerlegen und parallel bearbeiten lassen.

Orchestrator-Worker

Ein Lead-Agent zerlegt Aufgaben, delegiert an spezialisierte Worker und fasst Ergebnisse zusammen. Das am häufigsten eingesetzte Muster für komplexe Aufgaben — auch die Basis unserer eigenen Infrastruktur.

Handoff / Transfer

Agenten bewerten Aufgaben dynamisch und leiten sie an den spezialisiertesten Agenten weiter. Für Systeme, in denen die richtige Zuordnung erst aus der konkreten Anfrage entsteht.

Generator-Critic

Ein Agent erstellt Ergebnisse, ein zweiter prüft sie gegen definierte Kriterien — mit automatischer Korrekturschleife. Für Qualitätssicherung, automatisierte Prüfung und iterative Verbesserung.

Die AI-Landschaft 2026 — und wie wir sie nutzen

Wir sind kein Verfechter eines einzelnen Modells. AI-Systeme funktionieren am besten, wenn jede Komponente gezielt auf ihre Aufgabe abgestimmt ist — das richtige Werkzeug für die richtige Aufgabe.

Claude

Anthropic

Stärkste Coding- und Agent-Zuverlässigkeit. 1M Token Kontext. Extended Thinking für komplexe Aufgaben.

Einsatz: Orchestrierung, Coding, komplexe Entscheidungslogik, langfristige Aufgaben

Gemini

Führend in Multimodalität — verarbeitet Text, Bilder, Audio und Video nativ. Tiefe Cloud-Integration.

Einsatz: Multimodale Analyse, Bild-/Videoverarbeitung, Echtzeitdaten, Suche

GPT-5

OpenAI

Breites Allgemeinwissen, starke Reasoning-Modelle (o3, o3-pro). Größtes Ökosystem an Integrationen.

Einsatz: Allgemeine Aufgaben, breite Wissensbasis, Plugin-Ökosystem

Open-Weight

Llama · DeepSeek · Mistral · Qwen

Volle Datenkontrolle, keine API-Abhängigkeit. Anpassung durch Fine-Tuning möglich.

Einsatz: Datensouveräne Deployments, Spezialaufgaben, kostensensitive Workloads

Unser Spezialisierungsprinzip: Vom Basis-Modell bis zur Agenten-Konfiguration — jede Entscheidung wird gezielt auf die Aufgabe abgestimmt. MCP (Model Context Protocol) — seit 2025 offener Standard unter der Linux Foundation — ermöglicht es uns, Modelle flexibel zu kombinieren, ohne an einen Anbieter gebunden zu sein.

Was wir liefern

AI-Infrastruktur — vom Blueprint bis zum Betrieb

Das Ergebnis richtet sich nach Ihrer Situation: ein Blueprint, vollständige Agenten-Konfigurationen mit menschlichen Kontrollpunkten und Qualitätssicherung — oder eine vollständige, betriebsbereite AI-Infrastruktur. Kein Vendor-Lock-in. Ihre Infrastruktur gehört Ihnen.

Der entscheidende Unterschied zwischen AI-Systemen, die Mehrwert schaffen, und solchen, die nur Kosten verursachen: Architektur und Disziplin. Wer AI als Ingenieursprojekt behandelt, erzielt messbare Ergebnisse.

Konkrete Lieferungen

Unsere Infrastruktur ist der Beweis Was wir entwerfen, betreiben wir selbst — täglich, in Produktion.

Produktiv betrieben, nicht demonstriert:

2. August 2026 — EU AI Act Hochrisiko-Pflichten werden vollstreckbar

EU AI Act & Governance

AI-Systeme fallen unter die Definitionen des EU AI Acts — als KI-Systeme und potenziell als General-Purpose-AI-Modelle. Systeme, die in Hochrisiko-Bereichen operieren (Biometrie, kritische Infrastruktur, Personalwesen, Finanzdienstleistungen), unterliegen ab August 2026 vollständig den Kapitel-III-Anforderungen.

Transparenzpflichten nach Artikel 50 gelten, wenn AI-Systeme mit natürlichen Personen interagieren. Die regulatorischen Leitlinien für AI-Systeme sind noch vorläufig — frühzeitige Vorbereitung gibt entscheidenden Spielraum.

Was wir für Sie einordnen:

Strafen: bis zu 35 Mio. EUR oder 7% des globalen Jahresumsatzes. Detaillierte Compliance-Beratung: AI-Datenschutz & Compliance

Wie wir zusammenarbeiten

Technische Tiefe ohne langen Anlauf — in zwei Wegen.

Digitale Beratung

Beschreiben Sie Ihr Vorhaben — Ausgangslage, Anforderungen, offene Fragen. Wir analysieren, entwerfen und liefern Blueprint, Agenten-Konfiguration oder Infrastruktur-Artefakte — ohne Terminfindung, direkt strukturiert.

Ideal für:

Persönliches Gespräch

Für komplexe und sensible Systeme und Vorhaben, die eine vollständige Infrastruktur erfordern. Mit technischem Output und Begleitung wo sinnvoll.

Ideal für:

Buchung per E-Mail oder über unsere Kontaktseite.

Bereit für AI-Systeme, die wirklich funktionieren?

Beschreiben Sie Ihr Vorhaben — Ihre Anforderungen, Ihr Team, Ihre offenen Fragen. Wir melden uns mit einer konkreten Einschätzung.